AIが悪用される手口と対策|生成AIによるリスクから身を守る方法

昨今、生成AIの進化により、私たちの生活やビジネスは大きな恩恵を受けています。しかしその一方で、AIが悪用される事例も増えており、新たな脅威が生まれているのが現状です。

AIによるサイバー攻撃は、従来の手口よりも巧妙化、自動化されているため、組織・個人を問わず深刻な被害をもたらす可能性があります。この記事では、AIが悪用される具体的な手口と、生成AIの進化によってもたらされるリスクから身を守るための対策を解説します。

・【手口別】生成AIが悪用される主なサイバー攻撃7選

・【個人向け】AIによる詐欺や偽情報から身を守るための自衛策

・【法人向け】AIの悪用から組織情報を守るためのセキュリティ対策

・自組織が加害者にならないために|生成AI利用時に潜む法的・倫理的リスク

・まとめ

なぜ今、AIの悪用が深刻な問題となっているのか?

AIの悪用が深刻な問題となっている背景には、生成AI技術の急速な普及があります。

以前は専門的な知識や技術をもつ一部の攻撃者に限られていた高度なサイバー攻撃が、今では生成AIを使うことで誰でも比較的容易におこなえるようになりました。

AIによる攻撃は、その手口が巧妙であるうえ、自動化によって大量の攻撃を仕掛けることが可能です。

これにより、フィッシング詐欺やマルウェア開発といった犯罪のハードルが下がり、実際に被害につながる事件が世界中で増加しているため、大きな問題とされています。

【手口別】生成AIが悪用される主なサイバー攻撃7選

生成AIは、さまざまなサイバー攻撃に悪用されています。攻撃者はAIの能力を利用して、従来よりもはるかに巧妙で効率的な攻撃を仕掛けてきます。

ここでは、代表的な攻撃の手口として7つの事例を紹介します。どのような攻撃の事例があるのかを理解し、適切な対策を講じるための参考にしてください。

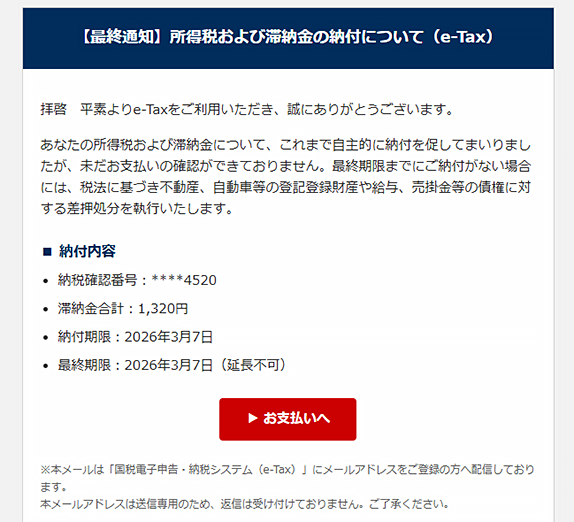

①より巧妙化するフィッシングメールの自動生成

生成AIを使ったフィッシングメールは、極めて自然で流暢な文章を自動で生成できます。

ターゲットの業種や役職、過去のやり取りといった情報にあわせて文面を最適化し、本物のビジネスメールと見分けがつきにくいのが特徴です。

これにより、受信者は疑いをもちにくく、添付ファイル開封や偽サイトへの誘導といった詐欺被害にあう可能性が高まります。従来の不自然な翻訳調の文章とは異なり、受信者を巧みに騙す手口が確立されています。

②ウイルス・マルウェアのコードを瞬時に作成

かつては高度なプログラミング技術が不可欠だったマルウェア開発ですが、生成AIの普及によりその状況は一変しました。攻撃者はAIとの対話を通じて、特定の機能をもつ悪意のあるコードを短時間で作成できます。

日本国内でも、IT知識の乏しい人物が生成AIを悪用し、わずか1か月ほどでランサムウェアのソースコードを完成させ逮捕された事例が報告されています。専門スキルをもたない個人でも、容易に攻撃ツールを手に入れられる時代に突入したといえるでしょう。

さらに、既存のコードを微修正して検知を回避するウイルスの亜種を大量に生みだすことも可能です。サイバー犯罪への参入障壁が下がり、攻撃の数と種類が急増する深刻な要因となっています。

③ディープフェイク技術による音声・動画のなりすまし詐欺

ディープフェイクとは、深層学習を用いて本物そっくりの音声や動画を合成する技術を指します。昨今、この技術を悪用して組織の経営者や上司になりすまし、偽の送金指示を出すビジネスメール詐欺(BEC)などの被害が深刻化しています。

2024年にはイギリス大手企業のアラップで、AIで作成された偽のテレビ会議に経理担当者が参加させられ、約40億円もの大金を振り込んでしまった事例も報告されました。

声や顔が本人と酷似しているため、ビデオ通話であっても不自然さに気づくことは非常に困難です。信頼している人物からの連絡という心理的な隙を突く、極めて悪質な手口といえます。

今後は、映像や音声のみで判断せず、多角的な確認をおこなう姿勢が求められます。

④SEO評価を不正に操作するAIスパムコンテンツの大量生成

生成AIを利用して、特定のキーワードを含んだ低品質なWebコンテンツを自動で大量に作りだし、検索エンジンの評価を不正に操作しようとするAIスパムが問題視されています。

これらのスパムサイトは、検索結果の上位に表示されることで広告収入や詐欺サイトへの誘導を狙っているのです。

結果として、ユーザーは有益な情報へたどり着きにくくなり、ネット上の情報全体の信頼性が低下する一因となります。Googleなどの検索エンジンは、このようなスパムへの対策を継続的に強化しています。

⑤SNSで社会を混乱させる偽情報(フェイクニュース)の拡散

生成AIは、もっともらしい嘘のニュース記事や偽の画像を簡単に作成できます。

これらはフェイクニュースとしてSNSなどで拡散され、世論操作や社会的なパニックを引きおこす目的で悪用されることがあります。

特に、選挙期間中の候補者に関する偽のニュースや、災害時に不安を煽る情報の拡散は、社会に大きな混乱をもたらしかねません。

情報の真偽を個人が見極めることが、ますます困難になっています。

⑥AIモデルの学習データを汚染するポイズニング攻撃

AIモデルそのものを標的とした攻撃も存在します。

ポイズニング攻撃は、AIが学習するデータに、攻撃者が意図的に悪意のあるデータや誤った情報を混入させる手口です。

汚染されたデータを学習したAIは、特定の状況で誤った判断や予測をおこなうようになります。

例えば、自動運転車が特定の標識を誤認識したり、セキュリティシステムが脅威を見逃したりするリスクが生じ、物理的な損害につながる危険性もはらんでいます。

⑦パスワードを高速で解析するブルートフォース攻撃の効率化

ブルートフォース攻撃は、パスワードを総当たりで試して不正ログインを狙う手口です。AIを活用することで、この攻撃はさらに効率化されます。

AIは、漏洩したパスワードのリストからよく使われる単語やパターンを学習し、推測の精度を高めます。これにより、従来の手法よりもはるかに短時間でパスワードを解読できるようになりました。

単純なパスワードを設定している場合、セキュリティリスクはこれまで以上に高まっています。

【個人向け】AIによる詐欺や偽情報から身を守るための自衛策

AIによる脅威は、組織だけでなく個人にも及んでいます。特にSNSやメールを通じた詐欺、偽情報の拡散は、私たちの日常生活に潜む身近な危険です。

しかし、正しい知識をもち慎重に行動することで、これらのリスクは大幅に軽減できます。

ここでは、個人で実践できる自衛のための対策を3つ紹介します。

発信元が不明な情報やURLを安易に信用しない

メールやSNSで送られてくるメッセージに記載されたURLは、安易にクリックしないことが基本です。

特に、有名な組織やサービスを装ったメッセージには注意が必要です。

送信元のメールアドレスが公式なものと一致しているか、URLのドメインに不審な点はないかを確認する習慣をつけましょう。

少しでも怪しいと感じたら、ブックマークや公式アプリなど、信頼できる経路からサイトにアクセスし、情報の真偽を確かめることがネット上のトラブルを避けるために重要です。

ディープフェイクを見破るための視点をもつ

近年のディープフェイク技術の進歩により、偽の動画や音声を完全に見破ることは難しくなっています。

しかし、注意深く観察することで不自然な点に気づける場合があります。

例えば、「動画内の人物の瞬きが異常に少ない」「顔の輪郭や影の動きに違和感がある」「肌の質感が不自然に滑らかである」といった点です。音声の場合も、「感情がこもっていない」「イントネーションがおかしい」などの特徴がみられることがあります。

違和感を覚えたら、すぐに信じずに複数の情報源を確認することが大切です。

個人情報のオンラインでの取り扱いに注意する

SNSなどに投稿した氏名、住所、勤務先、家族構成といった個人情報は、攻撃者にとって格好の標的です。

これらの情報は、フィッシング詐欺の文面をよりパーソナライズしたり、パスワードを推測したりするために悪用されるリスクがあります。

SNSのプライバシー設定を見直し、投稿の公開範囲を信頼できる友人のみに限定する、位置情報を含む写真の投稿を避けるなど、オンライン上での個人情報の取り扱いには細心の注意を払いましょう。

【法人向け】AIの悪用から組織情報を守るためのセキュリティ対策

AIによる脅威は、組織にとって無視できない経営リスクです。

巧妙化するサイバー攻撃から重要な情報資産を守るためには、多角的なセキュリティ対策が不可欠となります。

技術的な防御策にくわえ、従業員一人ひとりの意識向上も求められます。

ここでは、組織が取り組むべき具体的な対策を4つの側面から解説します。

生成AIの利用に関する社内ガイドラインを策定する

従業員が安全に生成AIを利用できるよう、明確な社内ガイドラインの策定が急務です。

このガイドラインには、入力が禁止される情報や、業務で利用してよいAIツールの範囲、生成物の著作権に関する注意点などを具体的に盛り込む必要があります。

ルールを定めることで、情報漏洩や著作権侵害といったリスクをおさえるだけでなく、従業員が無断で非公式なツールを利用するシャドーITの対策にもつながります。

従業員のセキュリティ意識を高める教育・訓練を実施する

技術的な対策をどれだけ強化しても、それを使う人間の意識が低ければセキュリティは担保できません。

AIが生成した巧妙なフィッシングメールを見抜く訓練や、不審な指示を受けた際の報告手順の周知など、定期的な教育と訓練が重要です。

従業員一人ひとりが「自分も標的になりうる」という当事者意識をもち、セキュリティ対策の重要性を理解することが、組織全体の防御力を高めるうえで不可欠な要素となります。

AIを活用した最新のセキュリティシステムを導入する

AIによって巧妙化する攻撃に対抗するためには、防御側もAI技術の活用が有効です。

EDR(Endpoint Detection and Response)やSIEM(Security Information and Event Management)といった最新のセキュリティツールは、AIを用いて不審な挙動を検知・分析します。

これらのツールは、従来のパターンマッチング型の対策では見逃してしまう未知のマルウェアや新たな攻撃手法を特定するのに役立ちます。

ゼロトラストに基づいたアクセス管理を徹底する

ゼロトラストは、「すべてのアクセスを信頼しない」という考えかたにもとづくセキュリティモデルです。

社内ネットワークからのアクセスであっても安全とは見なさず、すべての通信を検証します。

具体的な対策としては、多要素認証(MFA)の義務化や、従業員の役職に応じて必要最小限のデータにしかアクセスできないように権限を管理することが挙げられます。

これにより、万が一IDやパスワードが窃取された場合でも、被害を最小限に食い止めます。

自組織が加害者にならないために|生成AI利用時に潜む法的・倫理的リスク

生成AIは業務効率化に大きく貢献する一方、その利用方法を誤ると、組織が意図せず加害者側になってしまうリスクも存在します。

AIによるコンテンツ生成には、著作権侵害や個人情報の不適切な利用といった法的な問題が潜んでいます。利便性だけにとらわれず、利用ルールを明確に定め、慎重に運用することが求められます。

著作権や商標権を侵害してしまうコンテンツ生成のリスク

生成AIは、インターネット上の膨大なデータをもとにコンテンツを生成します。その過程で、学習データに含まれる既存の著作物や登録商標に酷似した文章、画像、デザインなどを意図せず生成してしまう場合があります。

これに気づかず自社のウェブサイトやマーケティング資料などで商用利用した場合、権利者から著作権や商標権の侵害を主張され、損害賠償請求や使用差し止めといったトラブルに発展しかねません。

AIの生成物はあくまで「下書き」と捉え、公開前に必ず人間の目でオリジナリティや類似性のチェックをおこなうべきです。

AIが生成した不正確な情報による信用の失墜

生成AIは、時に「ハルシネーション(幻覚)」とよばれる事実に基づかないもっともらしい嘘の情報を生成することがあります。

例えば、製品仕様や組織の沿革に関する質問に対して、AIが実在しない情報を提示してしまうケースが実際に確認されています。

このような不正確な情報をファクトチェックせず、公式サイトの見解や顧客への回答として発信してしまうと、組織の信用を損なう結果を招くリスクがあります。

AIの回答を鵜呑みにせず、必ず正確な情報源と照合し、事実確認を徹底するプロセスを用意しておくことが欠かせません。

低品質コンテンツの大量生成が招く検索エンジンからのペナルティ

検索エンジン最適化(SEO)を目的として、生成AIを用いて低品質な記事やページを大量に作成する行為は大きなリスクを伴います。

Googleをはじめとする検索エンジンは、ユーザーに価値を提供しない、検索順位の操作のみを目的としたコンテンツをスパム行為とみなします。

AIで自動生成しただけの、独自性や専門性に欠けるコンテンツをウェブサイトに大量投下する手法は、検索エンジンのガイドラインに違反する可能性が高いです。

発覚した場合、サイト全体の検索順位が大幅に下落するなどの厳しいペナルティを受けることがあります。

まとめ

AIの進化は社会に多くの便益をもたらす一方、その力を悪用した新たな脅威を生みだしています。

フィッシング詐欺の巧妙化から偽情報の拡散まで、その手口は多岐にわたり、組織・個人を問わずすべての人々が標的となりうるのが現状です。

これらの脅威に対抗するためには、AIを活用した最新のセキュリティツールを導入するといった技術的な対策と、ガイドライン策定や従業員教育といった組織的な対策をあわせておこなうことが不可欠です。

また個人レベルでも、情報の真偽を慎重に見極め、オンラインでの個人情報の取り扱いに注意するなど、デジタルリテラシーを高めることが求められます。

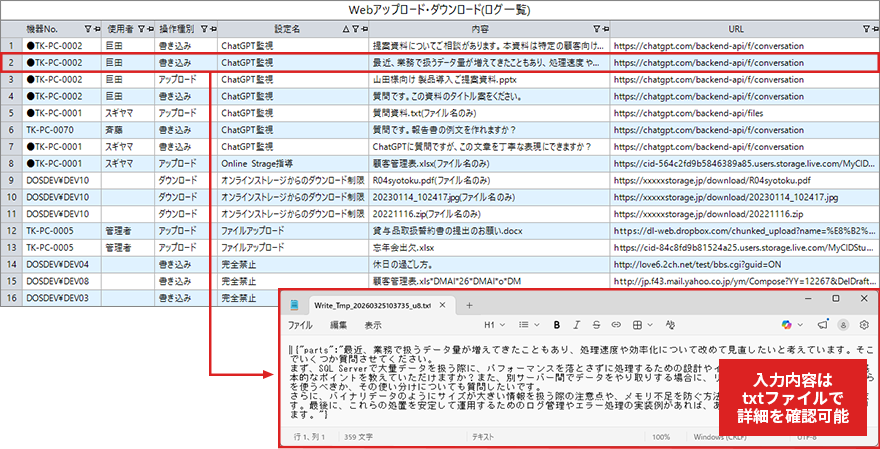

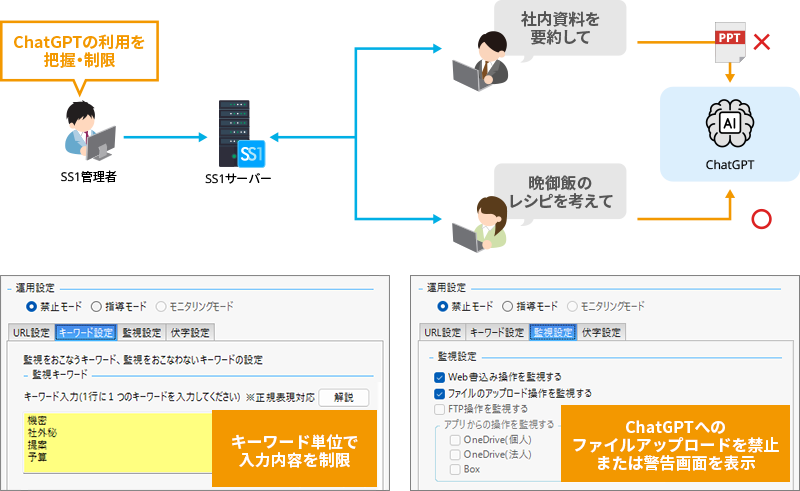

【TOPICS】IT資産管理ツール「SS1」でChatGPTへのテキスト・画像アップロード/ダウンロードログが取得可能

弊社が提供しているIT資産管理ツールSS1のver.17.1では、ChatGPTの利用にともなう情報漏洩対策機能が搭載されています。

ブラウザ経由でおこなわれたテキスト・音声入力や、画像のアップロード/ダウンロード履歴を詳細なログとして取得可能です。

さらに、キーワードを用いた書き込み制限や画像アップロードの制御にも対応しており、組織ポリシーに沿った安全な生成AI活用を実現します。利用状況の可視化と適切な制御を組み合わせることで、生成AIの悪用による情報流出リスクを大幅に低減できます。

SS1の詳細についてはこちらよりお問い合わせください。

IT資産管理ツールSS1/SS1クラウドを開発・販売している、株式会社ディー・オー・エスの営業企画部メンバーで構成されています。IT資産管理・ログ管理・情報セキュリティ対策など、情シス業務の効率化に役立つ最新トレンド情報を随時発信中!

セミナー情報

セミナー情報