ChatGPTの情報漏洩リスクとは?原因となる事例と組織でできる対策

ChatGPTは業務効率化に役立つ便利なツールですが、その利用には情報漏洩のリスクが伴います。

組織として安全に活用するためには、リスクの仕組みを正しく理解し、適切な対策を講じることが不可欠です。

この記事では、ChatGPTで情報漏洩がおこる原因や過去の具体的な事例を解説し、組織が今すぐ実践できる対策を紹介します。

・【国内外】実際に起きたChatGPTによる情報漏洩の事故事例

・ChatGPTの情報漏洩を防ぐための具体的な対策

・情報漏洩リスクを踏まえた組織におけるChatGPTの利用判断ポイント

・まとめ

なぜChatGPTで情報漏洩がおこるのか?3つの主な原因

ChatGPTで情報漏洩がおこる主な原因は、次の3つが挙げられます。

これらの原因を理解することが、適切なセキュリティ対策の第一歩となります。

原因1:入力した機密情報がAIの学習データとして利用される可能性

ChatGPTの個人向けプラン(無料版)では、利用者が入力したデータが開発元であるOpenAIのAIモデルの学習データとして利用されることがあります。

もし従業員が組織の機密情報や個人情報を入力した場合、そのデータがAIの学習に組み込まれ、将来的に他のユーザーへの回答として出力されてしまうリスクが存在します。

過去の研究や論文でも、AIモデルが学習データに含まれる個人情報を記憶し、特定の入力に対してそれを出力する可能性が指摘されており、重大な情報漏洩につながる恐れがあるのです。

原因2:システムのバグによる意図しない情報流出

どのようなシステムにも、バグやセキュリティ上の脆弱性が存在する可能性があります。

ChatGPTも例外ではなく、過去にはシステムの不具合によって、他のユーザーのチャット履歴タイトルが閲覧できてしまう事態が発生しました。

このように、開発元が意図しない形で情報が外部に流出するケースも考えられます。

サービス提供側のセキュリティ対策に依存する部分であるため、利用者側で完全にコントロールすることは難しいリスクといえます。

原因3:不正アクセスによるアカウント情報と過去の対話履歴の漏洩

不正アクセスによってアカウント情報が盗まれると、過去の対話履歴が外部に漏洩する深刻なリスクが生じます。

アカウント情報は、フィッシング詐欺やパスワードの使い回し、端末のマルウェア感染などによって流出しやすくなります。第三者に不正ログインされると、本人になりすまして組織内の問い合わせや取引先への対応がおこなわれるだけでなく、保存された履歴や連携サービスの情報が持ち出される恐れがあるのです。

過去の会話にAPIキーや顧客名が含まれていた場合、被害はさらに連鎖します。決済情報の不正利用やアカウント停止による業務停滞を招くほか、機密漏洩に伴う取引停止や信用失墜など、組織に多大な損害を与えます。

【国内外】実際に起きたChatGPTによる情報漏洩の事故事例

ChatGPTの利便性の裏側で、情報漏洩に関連する事件は実際に国内外で発生しています。

大手組織での機密情報流出や、システム自体の不具合による個人情報漏洩など、その内容はさまざまです。

これらの事故事例は、ChatGPTを利用するうえでのリスクが現実のものであることを示しており、対策を講じる重要性を浮き彫りにします。

事例1:大手企業の従業員が機密性の高いソースコードを入力し流出

2023年、韓国の大手企業であるサムスン電子で、従業員がChatGPTを業務利用した際に情報漏洩が発生しました。

半導体設備の測定データをはじめ、製品の歩留まりに関する情報や、機密性の高いソースコードをChatGPTに入力したことが原因です。

従業員がコードのデバッグや要約といった目的で安易に利用した結果、それらの機密情報がOpenAIのサーバーに送信され、AIの学習データとして外部に流出してしまいました。

事例2:開発元のバグで他ユーザーのチャット履歴タイトルが表示される不具合

2023年3月、ChatGPTにおいて一部のユーザーに自分以外の他ユーザーのチャット履歴タイトルが表示されるという不具合が発生しました。

この問題は、オープンソースのライブラリにあったバグが原因で引き起こされたものです。

このインシデントでは、有料プランユーザーの氏名やメールアドレス、クレジットカード情報の一部(有効期限や下4桁)などが漏洩した可能性も報告されており、サービス側の脆弱性が情報漏洩に直結した事例となりました。

事例3:共有リンク機能の仕様により社内情報が検索エンジンに公開

ChatGPTには対話内容を他者と共有できる共有リンク機能がありますが、過去にこの仕様が原因で情報が露出する問題がおこりました。

当初、作成されたURLはアクセス制限が緩く、検索エンジンのクローラーが内容をインデックスできる状態でした。その結果、意図せず共有された組織の議事録などが検索結果に表示され、第三者が閲覧できるリスクが生じたのです。

この事態を受け、OpenAIは検索エンジンへのインデックス登録機能を削除しました。現在は、ユーザーが明示的に共有を選択しない限り、チャット内容が公開されることはありません。

組織で利用する際は、便利な共有機能が時として予期せぬ範囲まで情報を広める可能性があると理解し、慎重に扱う姿勢が求められます。

ChatGPTの情報漏洩を防ぐための具体的な対策

ChatGPTの情報漏洩リスクは、適切な設定と運用ルールによって大きく低減できます。

情報漏洩を防ぐためには、個人がすぐに実践できる設定変更から、組織として導入すべきガイドラインやツールの活用まで、多層的な対策を講じることが重要です。

【個人向け】すぐ実践できる安全な使い方

個人でChatGPTを利用する際は、設定の変更や入力内容の管理によって情報漏洩リスクを大幅に下げることが可能です。

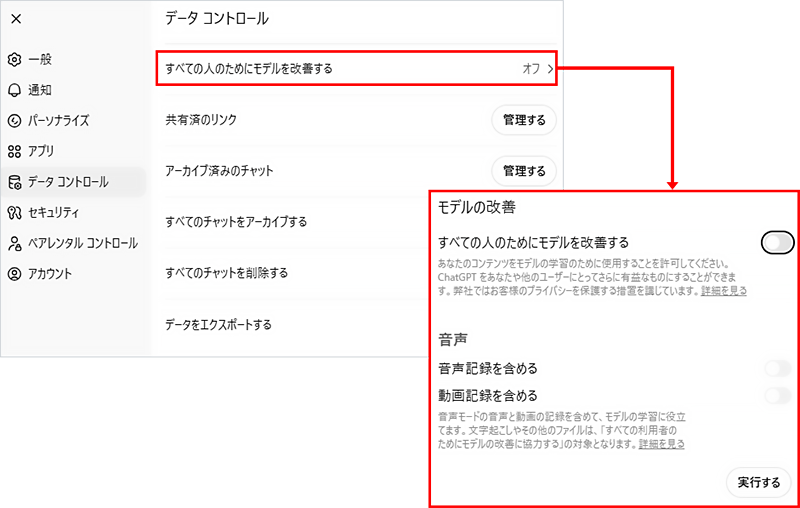

AIの学習を防ぐ設定方法(オプトアウト設定)

最も手軽で効果的な対策の一つが、AI学習への利用をオフにする設定です。

個人のアカウント設定画面にある「データコントロール」の項目から、「すべての人のためにモデルを改善する」をオフに切り替えます。

このオプトアウト設定をおこなうと、以降の対話内容はOpenAIのモデル学習に利用されなくなります。

機密情報を扱う可能性のある業務で利用する際には、まずこの設定をおこなうことが情報漏洩防止の基本となります。

個人名や顧客データなどの機密情報を入力しない

基本的な対策ですが、そもそも機密性の高い情報を入力しないというルールを徹底することが重要です。

個人情報、顧客の連絡先、組織の未公開財務データ、特許に関連する技術情報、非公開のソースコードなどは、絶対に入力しないように心掛ける必要があります。

どのようなセキュリティ設定やツールを導入しても、利用者のリテラシーが低ければリスクは残ります。

ChatGPTはあくまで公開情報をもとにした業務の補助ツールと位置づけ、機密情報を扱う作業には利用しないという明確な線引きが大切です。

【法人向け】ChatGPT導入前に整備すべきセキュリティ対策

組織としてChatGPTを導入する際は、個人レベルの対策に加えて、システム面やルール面での強固な管理が求められます。

情報漏洩のリスクを最小限におさえつつ、業務効率化を最大限に引き出すために検討すべき4つの具体的な施策について、以下で詳しく解説します。

ChatGPT利用に関する社内ガイドラインを策定し周知

組織としてChatGPTの利用を許可する場合、従業員が安全に使えるように明確なガイドラインを策定し、周知徹底することが不可欠です。

ガイドラインには、利用目的の範囲、入力が禁止される情報(個人情報、顧客情報、機密情報など)の具体例、利用時の注意点、問題発生時の報告手順などを明記します。

また、誤って機密情報を入力した場合の履歴削除の手順なども定めておくとよいでしょう。

作成したガイドラインは、研修などを通じて全従業員が正しく理解し、遵守するよう働きかける必要があります。

情報漏洩リスクの低い法人向けプランを導入

組織での本格的な活用を検討する場合、法人向け有料版プラン(ChatGPT Enterprise:2026年3月現在)の導入が有力な選択肢となります。

このプランは、入力されたデータがAIの学習に利用されないことが標準仕様となっており、情報漏洩リスクを大幅に低減できます。

また、シングルサインオン(SSO)によるアクセス管理、利用状況を監視できる管理コンソール、高度なデータ暗号化など、組織利用に求められるセキュリティ機能が強化されています。

API連携を活用して独自のセキュアな利用環境を構築

Webブラウザ版のChatGPTを利用するのではなく、APIを経由して自社の業務システムやアプリケーションにAI機能を組み込む方法も有効です。

OpenAIが提供するAPIを利用した場合、送信されたデータはAIモデルの学習には使われないと公式に明言されています。

この方式であれば、利用状況を組織の管理下に置きやすく、アクセスログの監視なども自社のセキュリティポリシーにあわせて設計できます。

開発コストは発生しますが、セキュリティを担保しながら柔軟な活用が可能になります。

DLPツールで機密情報の送信を監視・防止

より強固な情報漏洩を防ぐ技術的対策として、DLP(Data Loss Prevention)ツールの導入が挙げられます。

DLPツールは、組織のネットワーク内外のデータの動きを監視し、あらかじめ定義された機密情報や個人情報が外部のWebサービス(ChatGPTなど)に送信されそうになった際に、通信を自動で検知・ブロックする仕組みです。

従業員のヒューマンエラーによる情報流出を技術的に防ぐ最後の砦として機能し、組織のセキュリティレベルの向上が期待できます。

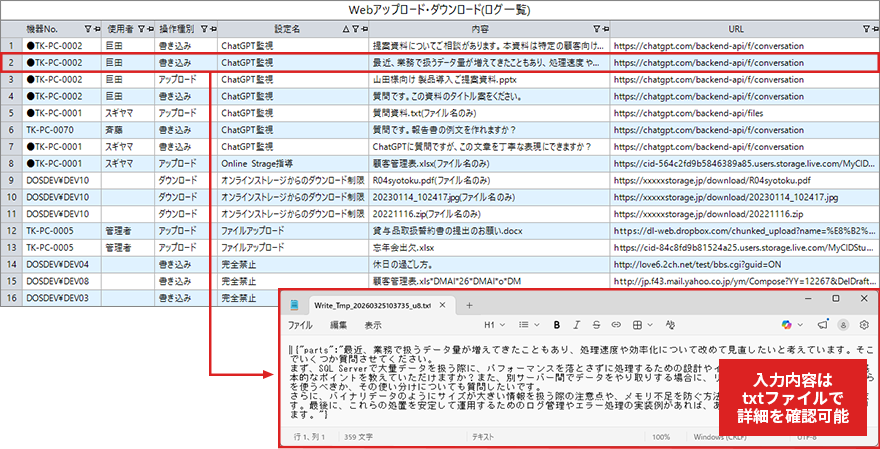

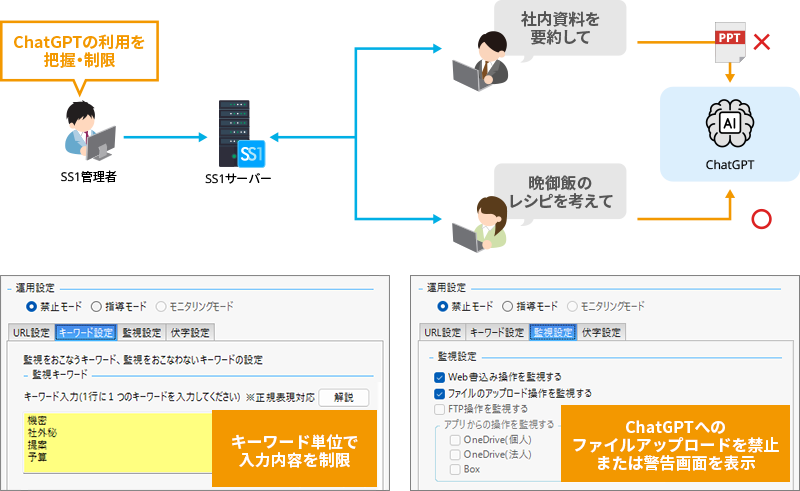

IT資産管理ツールで利用ログ取得・制限

IT資産管理ツールを活用すれば、ChatGPTへ入力されたテキストや音声、さらに画像のアップロードやダウンロードの履歴をログとして詳細に記録できます。

特定のキーワードを含む書き込みの制限や、画像ファイルのアップロード制御にも対応しているものもあり、管理者は従業員の利用状況を正確に把握し、必要に応じて操作を制限することが可能です。

生成AIの利用に伴うリスクが懸念されるなか、ツールの機能を活用して可視化と統制を強化すれば、組織の重要な情報の流出を未然に防ぎ、安全な利用環境を構築できます。

情報漏洩リスクを踏まえた組織におけるChatGPTの利用判断ポイント

ChatGPTの情報漏洩リスクを理解したうえで、組織としてその利用をどのように判断すべきか、悩むケースは少なくありません。

リスクを過度に恐れて利用を全面的に禁止するのか、それともリスクを管理しながら活用していくのか、組織の方針を明確にするための判断ポイントを整理します。

全面禁止ではなく利用ルールを定めて業務効率化を目指す

情報漏洩リスクを懸念してChatGPTの利用を全面禁止にするのは最も簡単な対策ですが、同時に業務効率化や生産性向上の大きな機会を失うことにもつながります。

より現実的なアプローチは、リスクを管理可能なレベルにおさえるための利用ルールを明確に設定し、その範囲内で積極的な活用を促すことです。

どのような情報を扱ってはならないかを具体的に示し、チャット履歴のオフ設定を義務付けるなど、安全な使い方を定義することで、リスクと利便性のバランスをとれるようになります。

安全な社内導入のために確認すべきセキュリティチェックリスト

組織としてChatGPTを安全に導入するためには、体系的なセキュリティ評価が不可欠です。

まず、利用目的と範囲を明確にし、それに応じたリスクを洗い出します。次に、入力禁止情報を定義したガイドラインを策定し、全従業員へ周知・教育をおこないます。

技術的な対策として、チャット履歴オフ設定の徹底や、よりセキュリティの高い法人向けプラン、API利用の検討を進めます。

また、利用状況を定期的に監査する仕組みを構築し、インシデント発生時の対応計画を準備しておくことも重要です。

まとめ

ChatGPTは業務効率を飛躍的に向上させる可能性がある一方、入力情報の学習利用やシステムの脆弱性などによる情報漏洩のリスクを内包しています。

しかし、これらのリスクは仕組みを理解し、適切な対策を講じることで管理可能です。

個人レベルでの履歴オフ設定や機密情報を入力しない意識付け、そして組織レベルでのガイドライン策定や法人向けプランの導入といった多層的な対策を組みあわせることで、安全にその便益を享受できます。

【TOPICS】IT資産管理ツール「SS1」でChatGPTへのテキスト・画像アップロード/ダウンロードログが取得可能

弊社が提供しているIT資産管理ツールSS1のver.17.1より、ブラウザ経由でおこなわれたChatGPTへのテキスト・音声入力および画像のアップロード・ダウンロード履歴もログとして取得可能になります。

あわせて、キーワードによる書き込み制限や画像アップロードの制御にも対応しています。

生成AIの利用が広がるなか、情報漏洩リスクへの対策としてChatGPT利用状況の可視化と統制を強化できる点が大きな特徴です。

SS1の詳細についてはこちらよりお問い合わせください。

IT資産管理ツールSS1/SS1クラウドを開発・販売している、株式会社ディー・オー・エスの営業企画部メンバーで構成されています。IT資産管理・ログ管理・情報セキュリティ対策など、情シス業務の効率化に役立つ最新トレンド情報を随時発信中!

セミナー情報

セミナー情報